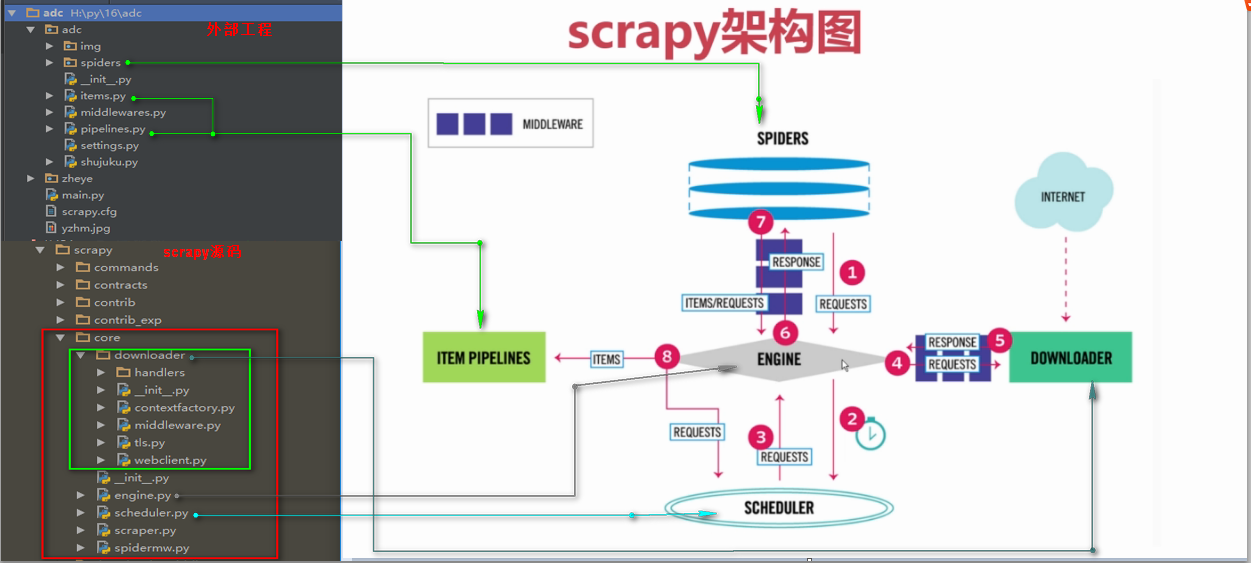

hon程序员用的是同样是爬虫框架,为何Scrapy深

1236x748 - 416KB - PNG

Python抓取框架 Scrapy的架构_神马软件站

648x473 - 24KB - JPEG

Scrapy爬取hupu论坛标题统计数量并生成word

750x496 - 42KB - JPEG

vs 2017 Python Scrapy环境安装 新建解决方案

497x373 - 24KB - JPEG

仅仅学会了requests和scrapy,你以为就足够了吗

640x428 - 24KB - JPEG

Scrapy:创建爬虫程序的方式

700x471 - 174KB - PNG

Scrapy: 10分钟写一个爬虫抓取美女图

640x319 - 11KB - JPEG

精通Python 爬虫框架Scrapy 图片预览

640x640 - 175KB - JPEG

十四 Python分布式爬虫打造搜索引擎Scrapy精

1251x563 - 215KB - PNG

python3网络爬虫 (4)-使用 scrapy 抓取知乎数据

640x307 - 25KB - JPEG

精通python网络爬虫 pdf网盘下载|精通Python网

303x391 - 77KB - PNG

python爬虫scrapy框架--人工识别知乎登录知乎

872x1264 - 169KB - JPEG

Python_1024

300x240 - 57KB - PNG

Scrapy学习笔记 - Python开发技术文章_教程 -

663x357 - 37KB - PNG

scrapy 知乎用户信息爬虫

580x570 - 29KB - JPEG

由于requests类库自带了Http Digest Auth,故搬砖到scrapy。加入如下MiddleWare,并在settings.py文件中

import redis from scrapy.dupefilter import BaseDupeFilter from scrapy.utils.request import request_

libstoken_auth.pyfrom flask_httpauth import httpbasicauth_author_=scrapy自带下载器中间件以下中间件

scrapy.Request函数还有一个metaauth=base64.b64encode({'帐号':'密码'})#base64需要导入 request.headers

Scrapyd cluster management,Scrapy log analysis&visualization,Basic auth,Auto packaging,Timer Tasks,

import scrapy class MoveItem(scrapy.Item):#定义爬取的数据的模型 title=scrapy.Field()auth=scrapy.

我在scrapy 中用mongodb 数据库的dbname=settings['MONGODB_DBNAME']#dbname.auth("MONGODB_USER","MONGODB

scrapy是不支持分布式的。分布式爬虫应该是在多台服务器(A B C服务器),他们不会重复交叉爬取AUTH"ranbos

Python版本管理:pyenv和pyenv-virtualenvScrapy爬虫入门教程一 安装和基本使用Scrapy爬虫入门教程二 官方

各位大神小牛, 抓取时候遇到需要用户名密码登录这种情况,想问一下大家是怎么玩的?本人试验了好久都不