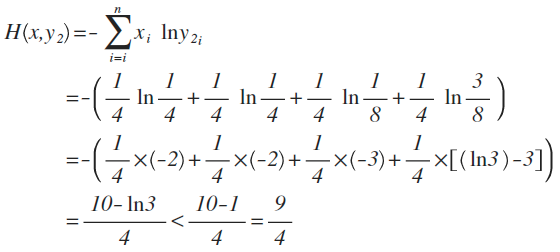

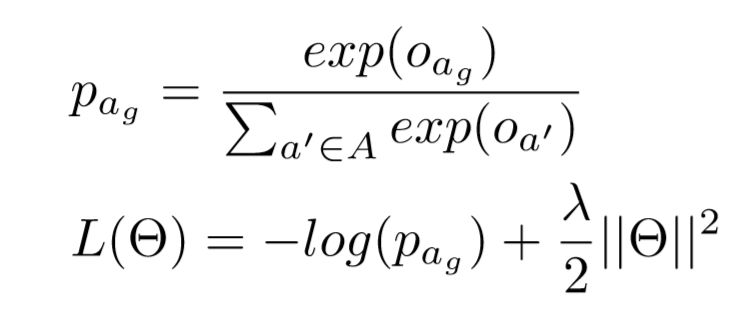

巧的是,训练数据的分布A是给定的。那么根据我们在第四部分说的,因为A固定不变,那么求 等价于求 ,也就是A与B的交叉熵。得证,交叉熵可以用于计算“学习模型的分布”与“

表达式是否解决学习缓慢的问题并不明显。实际上,甚⾄将这个定义看做是代价函数也不是显⽽易⻅的!在解决学习缓慢前,我们来看看交叉熵为何能够解释成⼀个代价函数。 将

海词词典,最权威的学习词典,专业出版交叉熵的英文,交叉熵翻译,交叉熵英语怎么说等详细讲解。海词词典:学习变容易,记忆很深刻。 交叉熵 交叉熵的英文翻译 基本释义 交叉熵

请听题:什么是熵?什么是交叉熵?什么是联合熵?什么是条件熵?什么是相对熵?它们的联系与区别是什么?如果你感到回答这些问题有些吃力,对这些概念似乎清楚,似乎又没有那

简介:语言模型的性能通常用交叉熵和复杂度(perplexity)来衡量。交叉熵的意义是用该模型对文本识别的难度,或者从

交叉熵容易跟相对熵搞混,二者联系紧密,但又有所区别。假设有两个分布 ,则它们在给定样本集上的交叉熵定义如下: 可以看出,交叉熵与上一节定义的相对熵仅相差了 已知时,可

交叉熵代价函数(Cross-entropy cost function)是用来衡量人工神经网络(ANN)的预测值与实际值的一种方式。与二次代价函数相比,它能更有效地促进ANN的训练。在介绍交叉熵

请听题:什么是熵?什么是交叉熵?什么是联合熵?什么是条件熵?什么是相对熵?它们的联系与区别是什么?如果你感到回答这些问题有些吃力,对这些概念

交叉熵可在神经网络(机器学习)中作为损失函数,p表示真实标记的分布,q则为训练后的模型的预测标记分布,交叉熵损失函数可以衡量p与q的相似性。交叉熵作为损失函数还有一

交叉熵可在神经网络(机器学习)中作为损失函数,p表示真实标记的分布,q则为训练后的模型的预测标记分布,交叉熵损失函数可以衡量p与q的相似性。交叉熵作为损失函数还有一

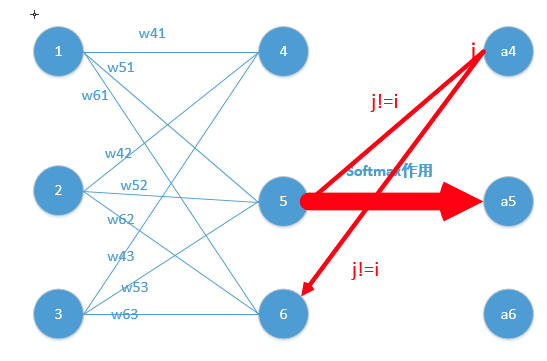

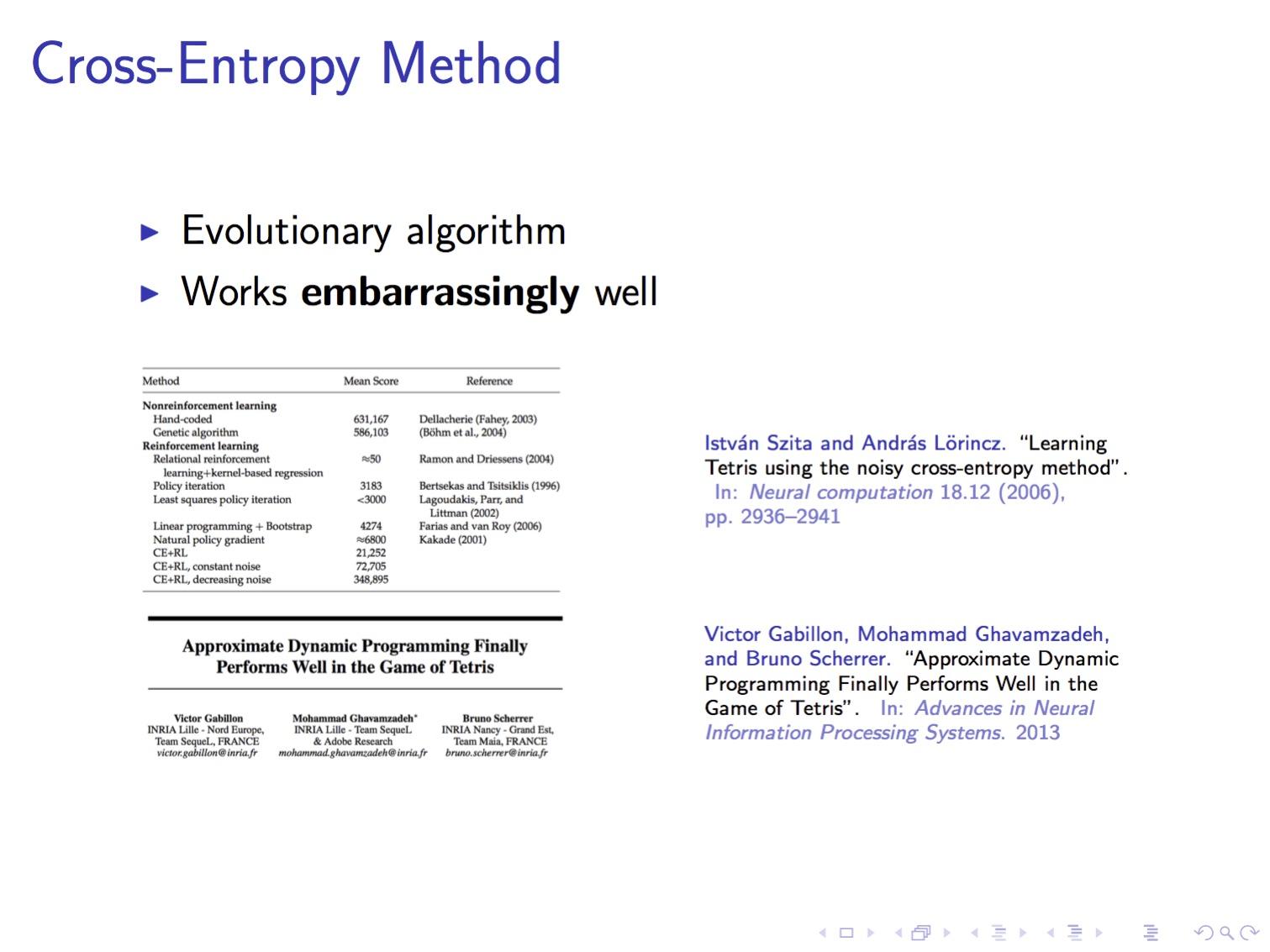

归一化(softmax)、信息熵、交叉熵

560x252 - 26KB - PNG

完美解释交叉熵

640x430 - 36KB - JPEG

完美解释交叉熵

510x552 - 24KB - JPEG

完美解释交叉熵

541x401 - 25KB - JPEG

完美解释交叉熵

574x408 - 25KB - JPEG

Softmax 函数的特点和作用是什么?

547x361 - 43KB - PNG

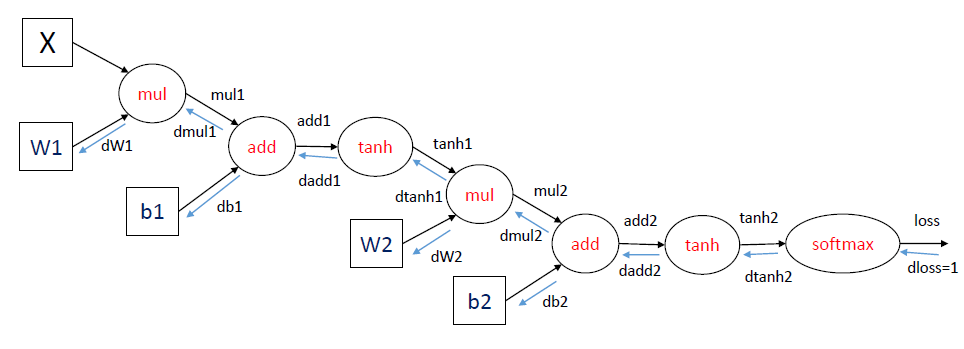

如何直观的解释back propagation算法? - 龚禹的

964x349 - 25KB - PNG

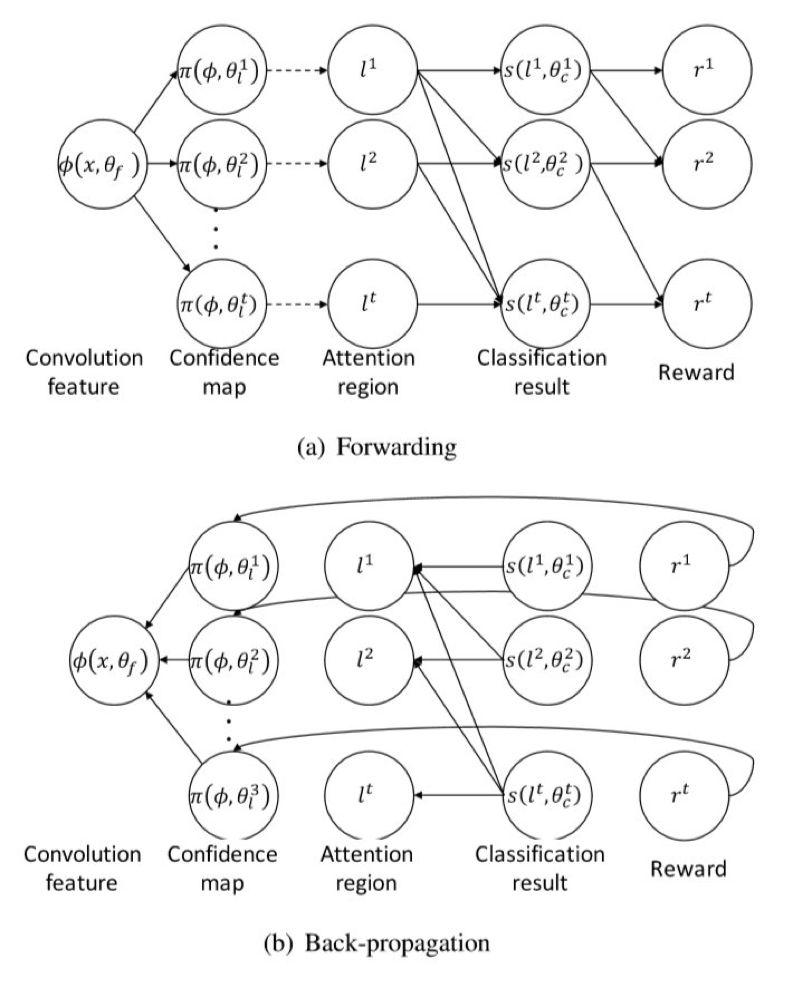

专访 | 五一出游赏花,如何优雅地解释百度细粒度

793x988 - 79KB - JPEG

什么是增强学习?

1511x1133 - 185KB - JPEG

什么是增强学习?

1511x1133 - 161KB - JPEG

什么是增强学习?

1511x1133 - 170KB - JPEG

循环神经网络RNN介绍1:什么是RNN、为什么需

873x356 - 27KB - JPEG

什么是人脸表情识别技术?

640x400 - 37KB - JPEG

什么是Transition-based基于转移的框架?

748x309 - 17KB - JPEG

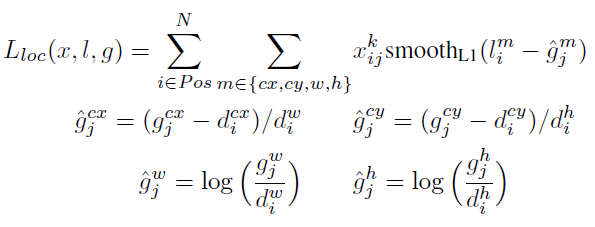

1. 什么是检测任务

595x227 - 32KB - JPEG